Najważniejsze informacje (kliknij, aby przejść)

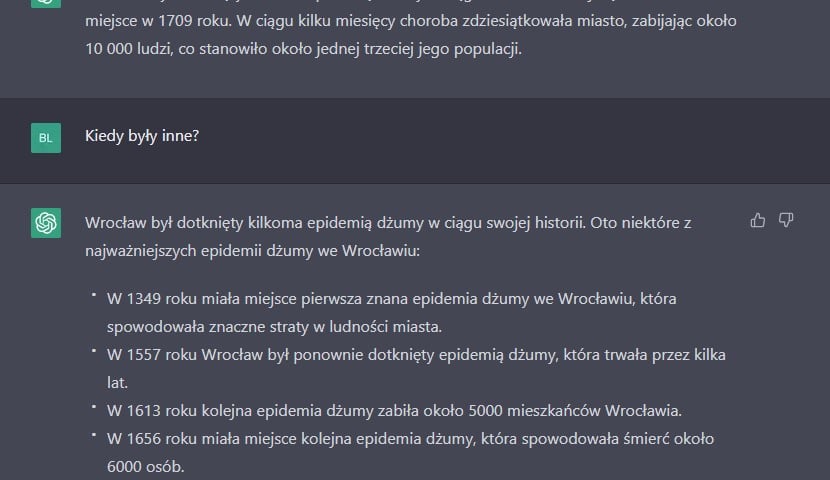

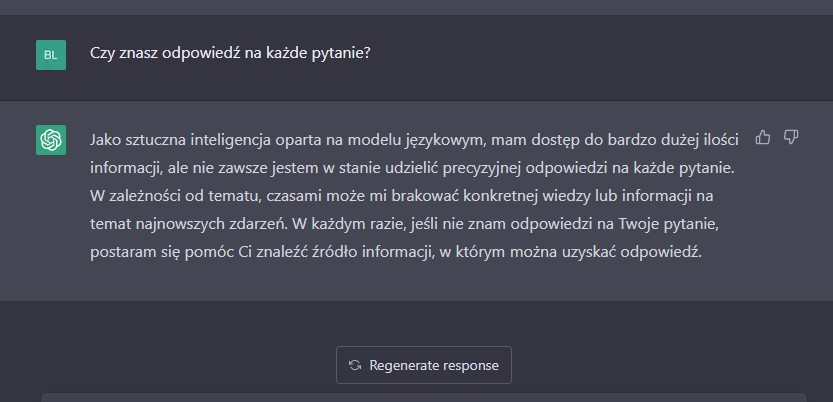

Znacie ChatGPT? To robot sztucznej inteligencji (działa jako strona www lub aplikacja w telefonie), który odpowie – teoretycznie – na każde pytanie. Oto przykład:

Rzeczywiście dobrze działa

ChatGPT został stworzony przez firmę OpenAI w grudniu ubiegłego roku. Szybko stał się bardzo popularny i chętnie wykorzystywany. W ciągu miesiąca korzystało z niego około 100 mln użytkowników, a teraz jest ich bodaj ponad 200 mln.

Jest pomocny w nauce czy pracy. Użytkownicy są zachwyceni jego rozległą wiedzą, rzekomą nieomylnością i poprawnością językową. Czy rzeczywiście jest wszechwiedzący i bezbłędny? Sprawdzili to badacze z Politechniki Wrocławskiej, którzy zadali sztucznej inteligencji ponad 38 tysięcy zapytań w 25 różnych kategoriach.

Zainspirował nas do badań przede wszystkim tym, że stał się popularny społecznie i ogólnie można powiedzieć, że rzeczywiście dobrze działa. Sprawdziliśmy m.in. jak reaguje na sarkazm, czy rozumie żarty i umie wychwycić szerszy kontekst wypowiedzi. Jakość odpowiedzi porównywaliśmy z wynikami osiąganymi przez inne, aktualnie najlepsze, wyspecjalizowane modele przetwarzania języka naturalnego.prof. Przemysław Kazienko z Katedry Sztucznej Inteligencji PWr

Znasz odpowiedź na każde pytanie?

Główny wniosek z badań: im trudniejsze zadania, tym gorzej wypadał robot. Pracownicy PWr przyłapali go na błędach, które „wychwyciłby niemal każdy człowiek”. — Mylił na przykład królów Polski. Nie był sobie w stanie poradzić przy szybkiej zmianie tematu. Już zaczęliśmy dalsze badania, w których mocniej skupimy się na temacie emocji. To dużo trudniejsze zagadnienie, które sprawia problemy nawet wyspecjalizowanym modelom językowym — porównuje prof. Przemysław Kazienko.

We wszystkich z 25 badanych obszarów robot wypadł gorzej od konkurentów. — W porównaniu do innych rozwiązań językowych był gorszy, ale nie beznadziejny. Okazuje się, że jest to dobre narzędzie do szybkiego znalezienia odpowiedzi, ale jeśli komuś zależy na wysokiej jakości wnioskowania, to jego wyniki mogą nie być wystarczająco dobre — ocenia profesor.

Rewolucja sztucznej inteligencji

Naukowcy dostrzegają mocne strony robota: świadomość kontekstu i możliwość personalizacji wypowiedzi, ale z drugiej strony wskazują zagrożenia, które niesie za sobą korzystanie z takiego narzędzia. — Bardzo poważne. Skoro ChatGPT dostarcza nam wiedzy i informacji, to po co sięgać do źródeł? Teraz szukając informacji, korzystamy z wyszukiwarki, wchodzimy na interesującą nas stronę i dzięki temu jej autor może na tym zarabiać. Skoro ChatGPT wszystko zaindeksował i daje nam odpowiedź od razu, to po co wchodzić na inne strony? Twórcy przestają zarabiać i cały model biznesowy się rozsypuje — tłumaczy prof. Przemysław Kazienko.

Innym wyzwaniem jest wykorzystanie robota przez uczniów. Naukowcy PWr są zdania, że tego typu rozwiązania powinny być wykorzystywane, a nie ograniczane. — Można je oczywiście zablokować na poziomie egzaminów czy innej formy sprawdzania wiedzy, podobnie jak smartfony, ale z drugiej strony chyba warto je wpleść w proces dydaktyczny. Pytanie tylko, czy przedstawiana nam wiedza jest obecnie nieomylna? Być może będą więc musiały powstać specjalizowane rozwiązania dla poszczególnych dziedzin nauki — sugeruje prof. Kazienko.

Profesor podkreśla, że z technologicznego punktu widzenia ChatGPT nie jest nowością. Swoje działanie opiera bowiem na modelu językowym GPT-3, który został opublikowany w 2020 roku, a jego pierwsza wersja powstała dwa lata wcześniej. Naukowiec przewiduje, że kolejne tego typu narzędzia będą pojawiały się coraz szybciej, napędzając niedawno rozpoczętą rewolucję sztucznej inteligencji.